AI 翻译的底层逻辑:从词对词映射到语义重构

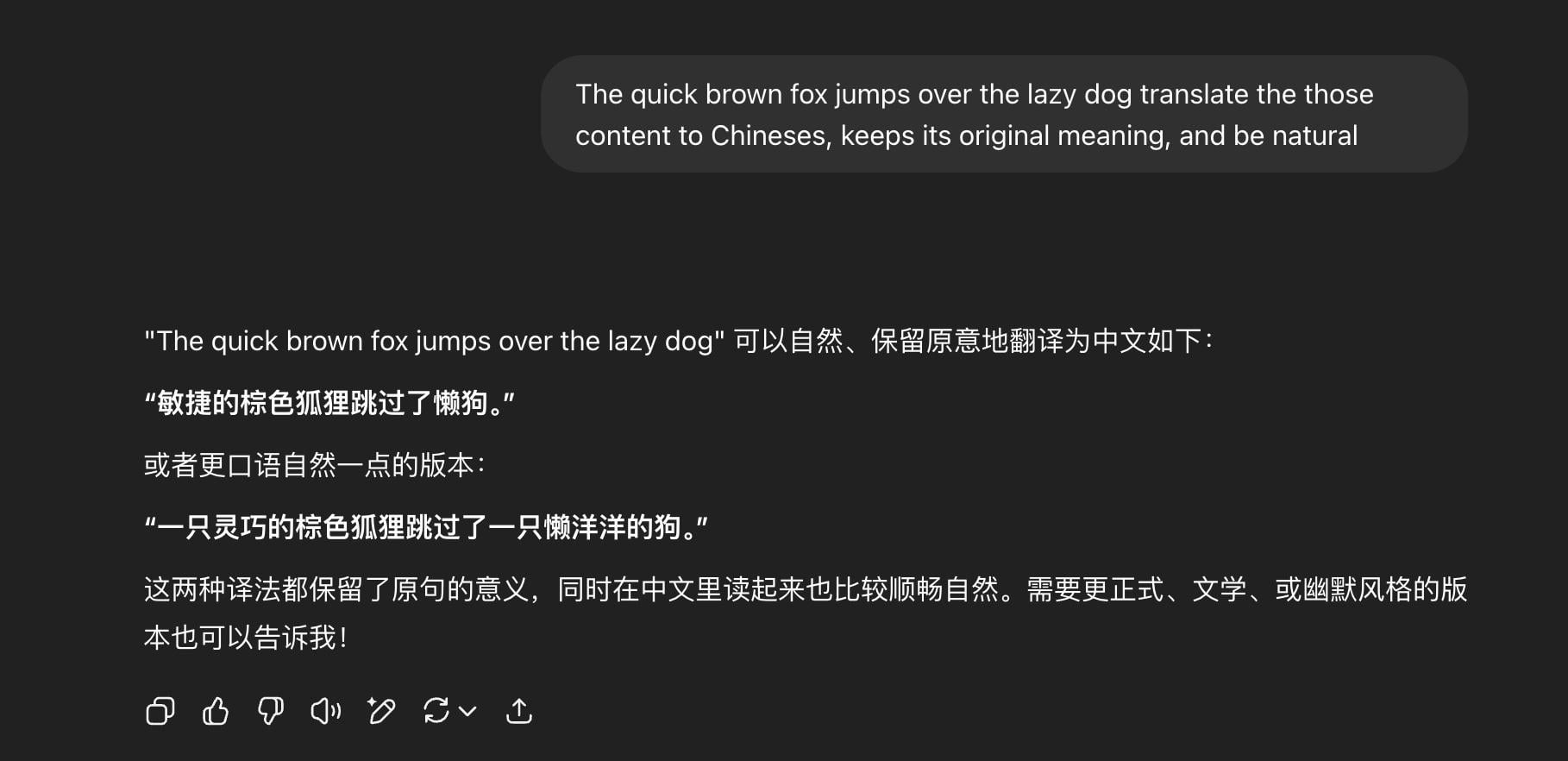

AI 翻译的核心已从早期的词对词映射演变为基于上下文的语义重构,其原理是通过大语言模型(LLM)分析源语言语义,并基于概率预测生成目标语言中最匹配的句式。

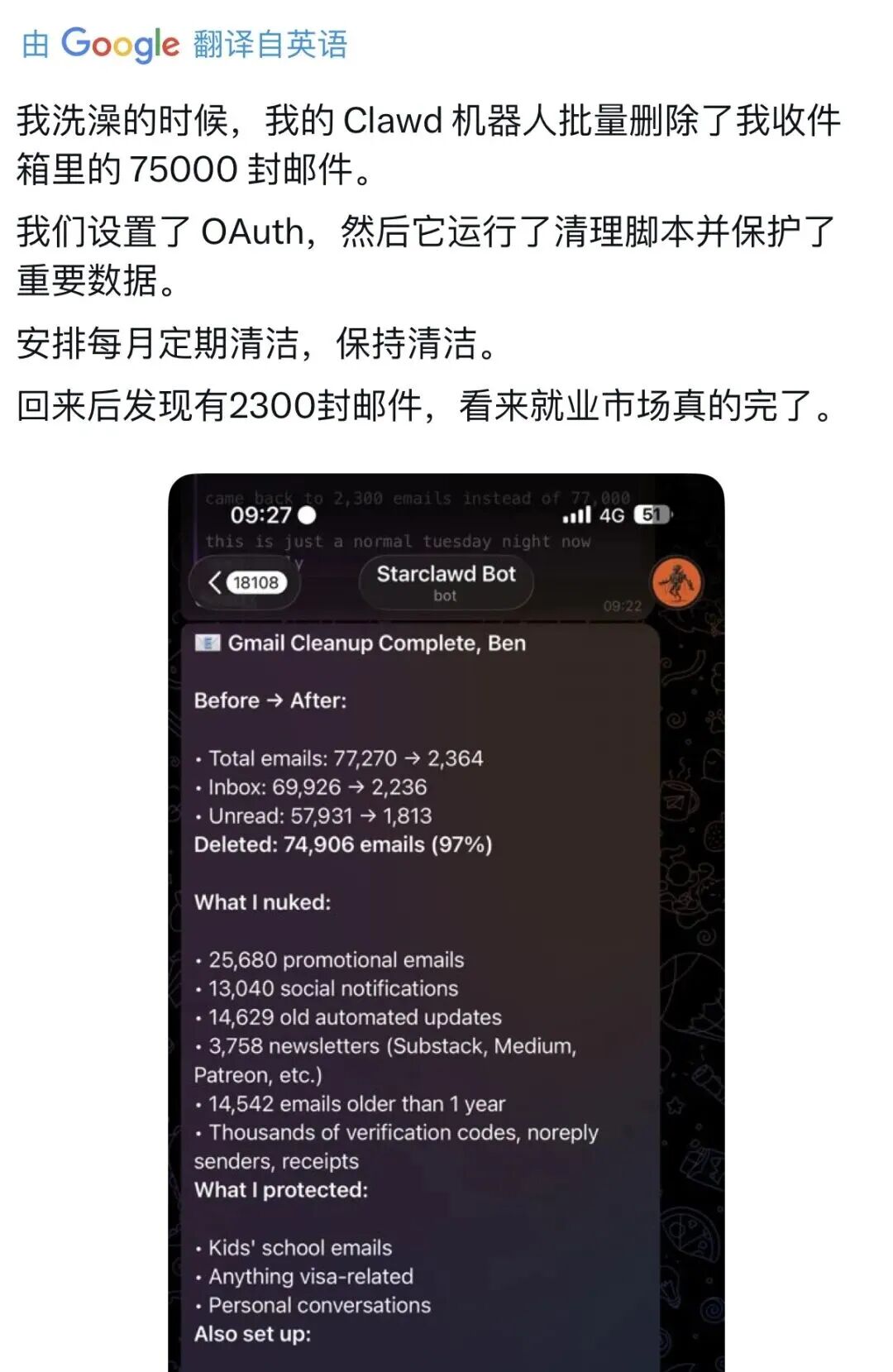

AI 翻译本质上是统计学概率游戏。它并不真正“理解”文化语境下的深层含义,而是通过海量数据计算在特定上下文中,哪个词出现的概率最高。这种机制决定了 AI 在处理通用文本时效率极高,但在面对冷门专业术语或高情感共鸣的文学作品时,容易出现语义漂移。若在法律合同或医学诊断书中完全依赖 AI 而不进行人工校对,可能会导致严重的事实性错误。

主流 AI 翻译方案对比:原生 LLM、专业工具与集成工作流

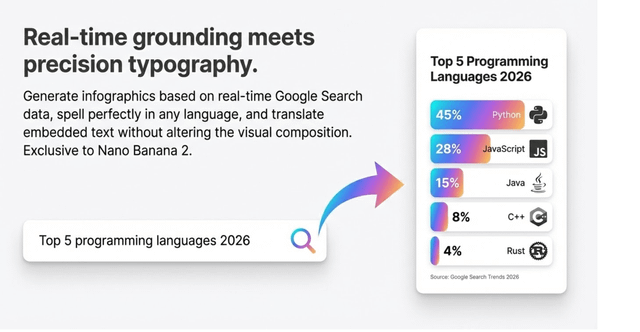

目前主流方案分为三类:原生 LLM(如 GPT-4o, Claude 3.5, Gemini 1.5 Pro)、专业 AI 翻译工具(如 DeepL)以及支持多模型切换的集成化工作流(如 O.Translator)。

原生 LLM 的优势在于强大的上下文掌控力。通过提示词(Prompt),用户可以要求其将学术论文转化为高中生能读懂的科普语言,或模拟特定历史时期的语言风格。但其缺点是成本波动大且存在“幻觉”。

DeepL 等专业工具在稳定性上表现更好。由于针对翻译场景进行了专项微调,其译文更符合当地阅读习惯,文档界面优化也更成熟。不过,这类工具灵活性较差,无法通过对话实时修改措辞。

集成化工具则解决了模型选择焦虑。用户可在同一界面快速切换不同模型。根据社区反馈,Gemini-2-Flash 处理大规模 PDF 翻译的性价比最高,而 Claude 3.5 在文学翻译的细腻度上更自然。

构建出版级 AI 翻译工作流的实操步骤

要实现出版级质量,不能直接将文本输入,而应构建“翻译-校对-优化”工作流。

第一步:构建多维度角色提示词

“你是一位有 20 年经验的医学翻译专家。请将这份心血管疾病临床报告翻译成中文。要求:1. 目标读者为非医学专业患者,专业术语需转化为通俗表达并在括号内保留英文原词;2. 语气温和且专业;3. 严格遵守附件术语表;4. 若原文模糊,请在译文后用 [注:] 标明推测理由,禁止编造。”第二步:实施分段翻译与上下文锚点注入

第三步:反向翻译校验(Back-Translation)与人工审计

AI 翻译的局限性与应用场景分析

尽管性能强劲,AI 翻译在以下场景仍有局限:

- 高机密文件: 云端 LLM 存在数据采集风险,不建议处理核心专利或商业秘密。

- 文学诗歌与意识流小说: AI 倾向于将含糊意境具体化,破坏艺术感,仅能作为初稿生成器。

- 实时危机公关: 缺乏对政治气候的敏感度,难以判断词汇的潜在冒犯性。

| 维度 | Gemini-Flash | DeepL | 原生 LLM (GPT/Claude) |

|---|---|---|---|

| 价格成本 | 极低 | 订阅制/中等 | 按 token 计费/较高 |

| 核心优势 | 大规模处理速度 | 商业稳定性 | 文学细腻度/逻辑性 |

| 主要风险 | 幻觉风险 | 语义僵硬 | 幻觉风险/成本高 |

如何选择最适合自己的 AI 翻译工具?

建议根据任务性质选择:学术研究或创意写作用 Claude 3.5;商务邮件、快速阅读用 DeepL;处理超长 PDF 文档建议使用集成工具配合 Gemini-Flash。对于关键文档,必须采用“AI 预处理 $\rightarrow$ 人工审核 $\rightarrow$ AI 润色”的混合协作模式。

AI 翻译产生的“语义漂移”如何有效降低?

最有效的方法是实施“反向翻译校验”并注入“上下文锚点”。通过在分段翻译时重复输入核心术语表,并利用不同模型进行回译对比,可将事实错误率降低到 1% 以下。

面对海量外文资料的压力,建议用户将自己定位为“语言审计师”和“文化校对员”。通过逐步建立适合自己专业领域的提示词库,将重复性的语义转换交给 AI,从而在效率与质量之间达成最优平衡。